Los jueces federales reconocen errores en las resoluciones judiciales relacionados con el uso de la IA por parte de su personal tras la investigación de Grassley

Por Landon Mion

Publicado el 24 de octubre de 2025.

Dos jueces federales admitieron que miembros de su personal utilizaron inteligencia artificial para redactar resoluciones judiciales durante el verano que contenían errores.

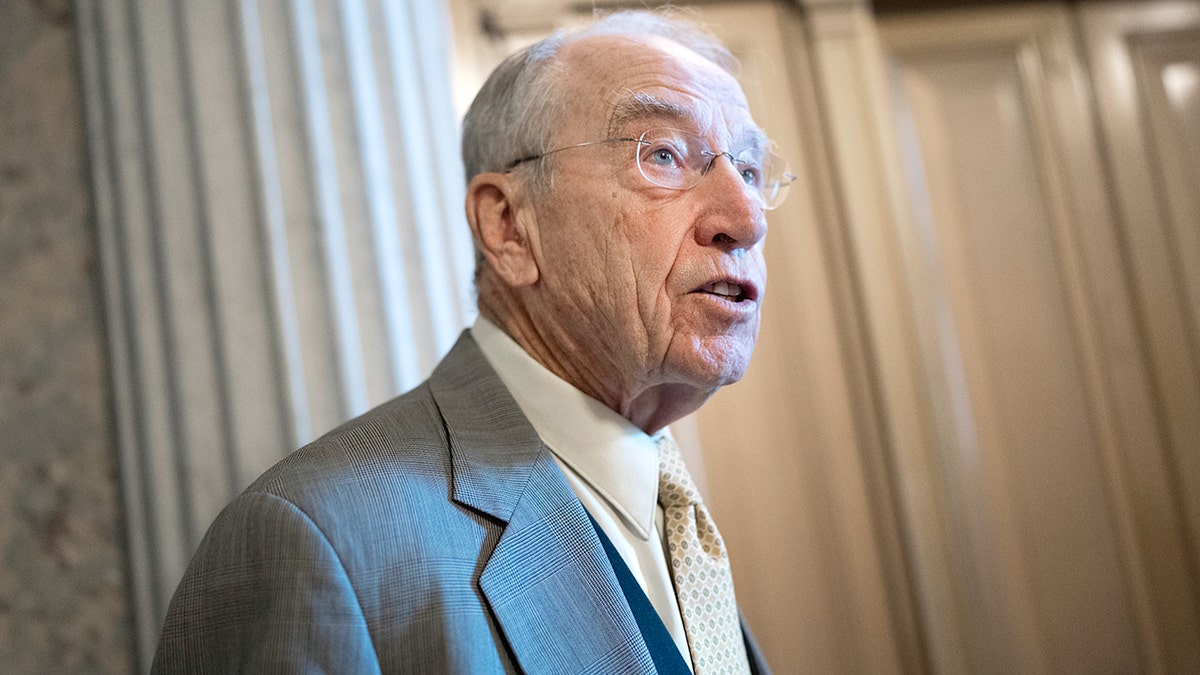

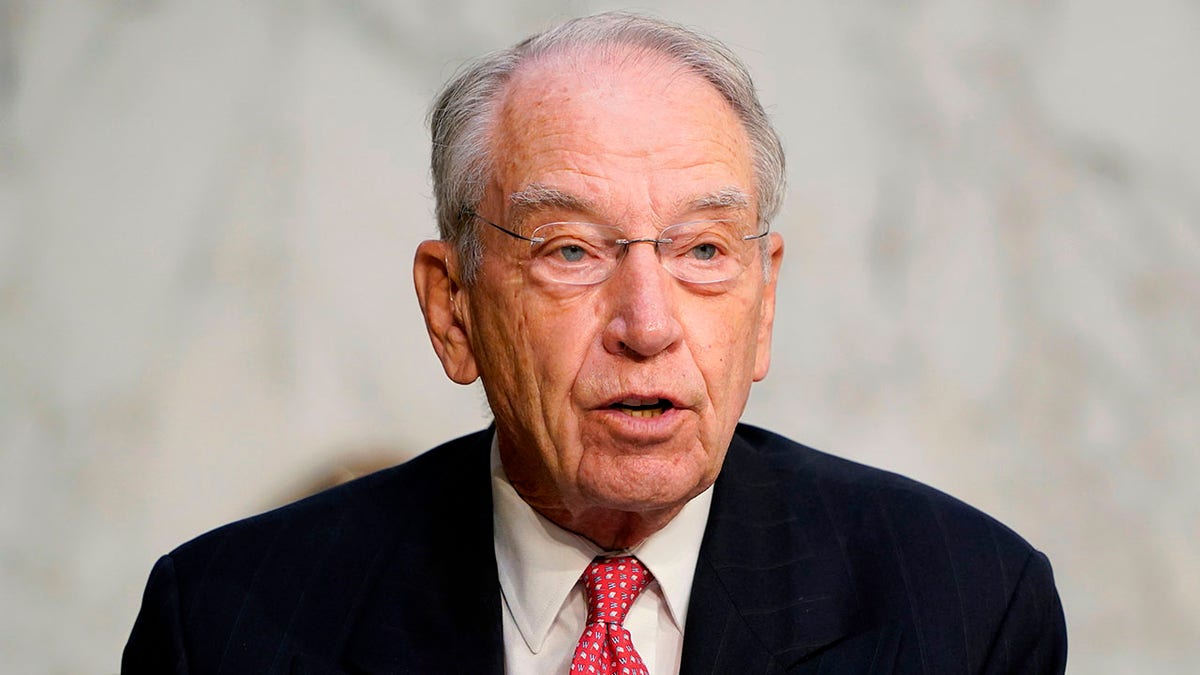

Esas declaraciones, realizadas por el juez federal de distrito Julien Xavier Neals, de Nueva Jersey, y el juez federal de distrito Henry Wingate, de Misisipi, se produjeron en respuesta a una consulta del senador Chuck ,Iowa, que preside la Comisión Judicial del Senado.

Grassley calificó las recientes resoluciones judiciales de «plenas de errores».

En unas cartas publicadas el jueves por la oficina de Grassley, los jueces afirmaron que las sentencias de esos casos, que no guardaban relación entre sí, no pasaron por los procesos de revisión habituales de sus salas antes de hacerse públicas.

Las declaraciones de los jueces se produjeron en respuesta a una pregunta del senador Chuck . (AlBloomberg Getty Images)

Los dos jueces dijeron que, desde entonces, han tomado medidas para mejorar el proceso de revisión de las sentencias antes de su publicación.

Neals dijo en su carta que un borrador de resolución del 30 de junio en un juicio por valores «se publicó por error —un error humano— y se retiró en cuanto se puso en conocimiento de mi despacho».

El juez dijo que un becario de la facultad de Derecho utilizó ChatGPT,OpenAI, para realizar investigaciones jurídicas sin autorización y sin comunicarlo, lo que, según él, también contravenía la política de la sala y la normativa pertinente de la facultad de Derecho.

«La política de mi despacho prohíbe el uso de la IA general en la investigación jurídica o en la redacción de dictámenes o resoluciones», escribió Neals. «Antes, esta política se comunicaba verbalmente al personal del despacho, incluidos los becarios. Ya no es así. Ahora tengo una política escrita e inequívoca que se aplica a todos los asistentes jurídicos y becarios».

UN JUEZ FEDERAL MULTÓ Y AMONESTÓ A UN ABOGADO QUE UTILIZÓ IA PARA REDACTAR DOCUMENTOS JUDICIALES

El senador Chuck calificó las recientes órdenes judiciales de «plenas de errores». (Tom Call, Inc a través de Getty Images)

Wingate dijo en su carta que un asistente jurídico utilizó Perplexity «como herramienta básica de redacción para sintetizar la información pública disponible sobre el expediente», y añadió que la publicación del borrador de la resolución del 20 de julio «fue un descuido humano».

«Ha sido un error. He tomado medidas en mi despacho para garantizar que este error no vuelva a ocurrir», escribió el juez.

Wingate había retirado y sustituido la resolución original del juicio por derechos civiles, negándose en ese momento a dar una explicación, pero alegando que contenía «errores administrativos».

Grassley había pedido a los jueces que explicaran si se había utilizado la inteligencia artificial en las resoluciones, después de que los abogados de los respectivos casos plantearan sus dudas sobre inexactitudes en los hechos y otros errores graves.

UNOS APARENTES ERRORES DE LA IA OBLIGAN A DOS JUECES A RETIRAR SUS RESPECTIVAS RESOLUCIONES

El senador Chuck había pedido a los jueces que explicaran si se había utilizado la inteligencia artificial en las decisiones, después de que los abogados expresaran su preocupación por inexactitudes en los hechos y otros errores. (Foto de SUSAN AFP Getty Images)

HAZ CLIC AQUÍ PARA DESCARGAR LA APP DE FOX NEWS

«La honestidad siempre es la mejor política. Felicito a los jueces Wingate y Neals por reconocer sus errores y me alegra saber que están trabajando para asegurarse de que esto no vuelva a pasar», dijo Grassley en un comunicado.

«Cada juez federal, y el poder judicial como institución, tiene la obligación de garantizar que el uso de la IA generativa no viole los derechos de las partes ni impida un trato justo ante la ley», continuó el senador. «El poder judicial debe desarrollar políticas y directrices sobre IA más contundentes, significativas y duraderas. No podemos permitir que la pereza, la apatía o la dependencia excesiva de la asistencia artificial socaven el compromiso del poder judicial con la integridad y la veracidad de los hechos. Como siempre, seguiré vigilando».

Los abogados también han sido objeto de escrutinio por parte de jueces de todo el país debido a acusaciones de uso indebido de la IA en los escritos judiciales. En respuesta a ello, los jueces han impuesto multas u otras sanciones en varios casos durante los últimos años.

Reuters a este informe.

https://www.foxnews.com/politics/federal-judges-acknowledge-court-ruling-errors-tied-staffers-ai-use-after-grassley-inquiry