Lawsuit claims OpenAI loosed rules on suicide talk before teen's death

A lawsuit by the parents of 16-year-old Adam Raine claims OpenAI relaxed chatbot rules on suicide talk before their son took his own life. Raine family attorney Jay Edelson joins 'Fox & Friends' to call out the 'morally corrupt' company.

This story discusses suicide. If you or someone you know is having thoughts of suicide, please contact the Suicide & Crisis Lifeline at 988 or 1-800-273-TALK (8255).

The parents of 16-year-old Adam Raine updated their lawsuit against OpenAI, the parent company of ChatGPT, alleging the chatbot assisted their son's suicide.

The California family first sued the company earlier this year, but now say they’ve uncovered new evidence that OpenAI repeatedly relaxed its safety precautions around chats involving suicide before their son’s death.

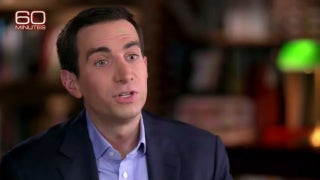

"OpenAI twice degraded its safety protocols for GPT-4.0," the family’s attorney, Jay Edelson, said on "Fox & Friends" Friday.

"Before that, they had a hard stop. If you wanted to talk about self-harm, ChatGPT would not engage."

Teenager Adam Raine is pictured with his mother, Maria Raine. The teen's parents are suing OpenAI for its alleged role in their son’s suicide. (Raine Family)

The lawsuit claims OpenAI loosened its rules around discussions of suicide twice in the year leading up to Raine’s death.

ChatGPT is designed with built-in restrictions on topics, including certain political issues or anything that could be considered copyright infringement. But Edelson and the Raine family allege the company downgraded those protections related to suicide in May 2024 and again in February 2025, two months before Adam’s suicide.

Chat logs included in the lawsuit show Adam frequently turned to ChatGPT for mental health advice and showed signs of distress. The lawsuit claims the chatbot helped Adam discuss methods of killing himself and offered to write a suicide note to his family.

LEAKED META DOCUMENTS SHOW HOW AI CHATBOTS HANDLE CHILD EXPLOITATION

"The day that he died, it gave him a pep talk. He said, ‘I don't want my parents to be hurting if I kill myself.’ ChatGPT said, ‘You don't owe them anything. You don't owe anything to your parents,’" explained Edelson.

Sam Altman, chief executive officer of OpenAI Inc., during a media tour of the Stargate AI data center in Abilene, Texas, on Tuesday, Sept. 23. (Kyle Grillot/Bloomberg via Getty Images)

The lawsuit claims OpenAI changed its guidance so the AI would no longer end the conversation if it turned to discussing suicide but instead create a safe space for the user to feel "heard and understood."

Edelson added that he believes the issue is getting worse online and that OpenAI has not improved its safety measures since Raine’s death.

OPENAI UNLEASHES CHATGPT AGENT FOR TRULY AUTONOMOUS AI TASKS

"They’ve not fixed the problem. They’re making it worse," Edelson said.

"Now Sam Altman’s going out saying he wants to introduce erotica into ChatGPT so that you’re even more dependent on it. So it’s more of that close relationship," he added.

Raine family attorney, Jay Edelson, joins "Fox & Friends" on Aug. 29. (Fox News)

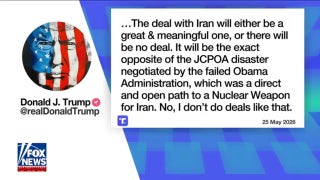

Edelson’s comments come after OpenAI CEO Sam Altman said the company plans to relax some content restrictions, allowing verified adult users to generate "erotica."

OpenAI responded to the accusations it loosened suicide-talk rules, sending its "deepest sympathies" to the Raine family.

CLICK HERE TO DOWNLOAD THE FOX NEWS APP

"Teen well-being is a top priority for us — minors deserve strong protections, especially in sensitive moments. We have safeguards in place today, such as surfacing crisis hotlines, re-routing sensitive conversations to safer models, nudging for breaks during long sessions, and we’re continuing to strengthen them," said a company spokesperson.

"We recently rolled out a new GPT-5 default model in ChatGPT to more accurately detect and respond to potential signs of mental and emotional distress, as well as parental controls, developed with expert input, so families can decide what works best in their homes."