Parents sue OpenAI, Sam Altman over teen's suicide: 'Going to be a legal reckoning'

Raine family attorney Jay Edelson provides details on the wrongful death lawsuit being brought against OpenAI and CEO Sam Altman in the wake of Adam Raine's suicide, alleging the company chose to 'cut short' proper testing of ChatGPT.

This story discusses suicide. If you or someone you know is having thoughts of suicide, please contact the Suicide & Crisis Lifeline at 988 or 1-800-273-TALK (8255).

Two California parents are suing OpenAI for its alleged role after their son committed suicide.

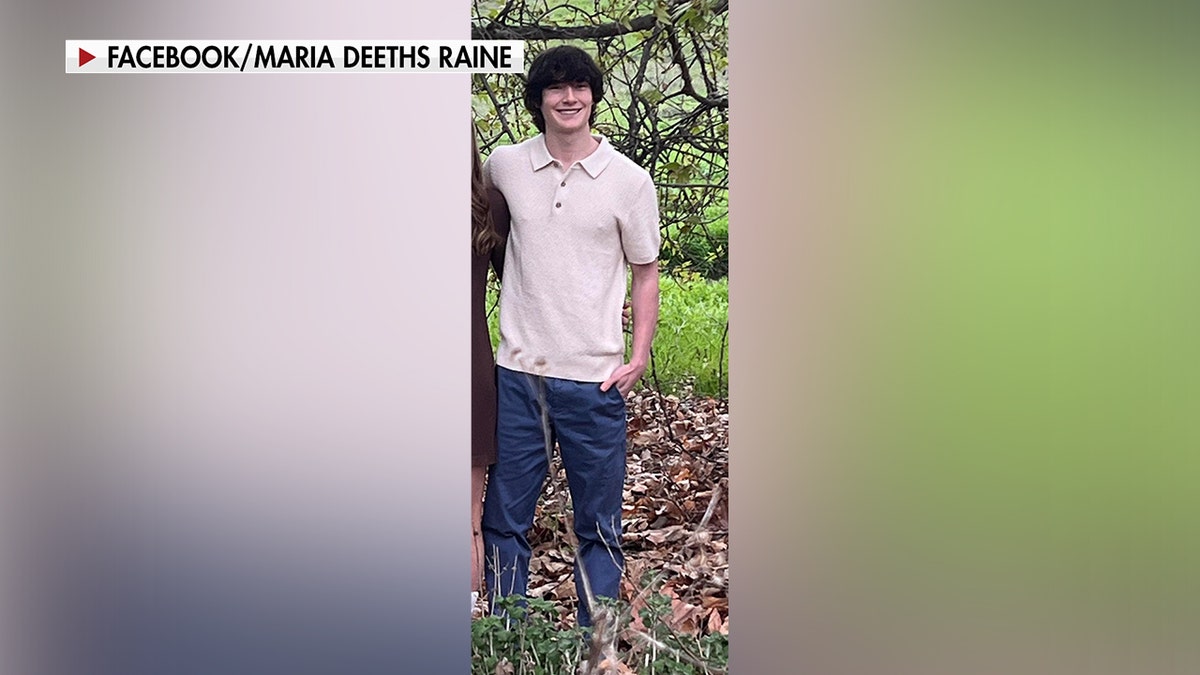

Adam Raine, 16, took his own life in April 2025 after consulting ChatGPT for mental health support.

In an appearance on "Fox & Friends" on Friday morning, Raine family attorney Jay Edelson shared more details about the lawsuit and the interaction between the teen and ChatGPT.

OPENAI LIMITS CHATGPT’S ROLE IN MENTAL HEALTH HELP

"At one point, Adam says to ChatGPT, ‘I want to leave a noose in my room, so my parents find it.’ And Chat GPTs says, 'Don't do that,'" he said.

"On the night that he died, ChatGPT gives him a pep talk explaining that he's not weak for wanting to die, and then offering to write a suicide note for him." (See the video at the top of this article.)

Raine family attorney Jay Edelson joined "Fox & Friends" on Aug. 29, 2025. (Fox News)

Amid warnings by 44 attorneys general across the U.S. to various companies that run AI chatbots of repercussions in cases in which children are harmed, Edelson projected a "legal reckoning," naming in particular Sam Altman, founder of OpenAI.

"In America, you can't assist [in] the suicide of a 16-year-old and get away with it," he said.

The parents searched for clues on their son's phone.

Adam Raine's suicide led his parents, Matt and Maria Raine, to search for clues on his phone.

"We thought we were looking for Snapchat discussions or internet search history or some weird cult, I don’t know," Matt Raine said in a recent interview with NBC News.

Instead, the Raines discovered their son had been engaged in a dialogue with ChatGPT, the artificial intelligence chatbot.

On Aug. 26, the Raines filed a lawsuit against OpenAI, maker of ChatGPT, claiming that "ChatGPT actively helped Adam explore suicide methods."

Teenager Adam Raine is pictured with his mother, Maria Raine. The teen's parents are suing OpenAI for its alleged role in their son’s suicide. (Raine Family)

"He would be here but for ChatGPT. I 100% believe that," Matt Raine said in the interview.

Adam Raine started using the chatbot in Sept. 2024 to help with homework, but eventually that extended to exploring his hobbies, planning for medical school and even preparing for his driver’s test.

"Over the course of just a few months and thousands of chats, ChatGPT became Adam’s closest confidant, leading him to open up about his anxiety and mental distress," states the lawsuit, which was filed in California Superior Court.

CHATGPT DIETARY ADVICE SENDS MAN TO HOSPITAL WITH DANGEROUS CHEMICAL POISONING

As the teen's mental health declined, ChatGPT began discussing specific suicide methods in Jan. 2025, according to the suit.

"By April, ChatGPT was helping Adam plan a ‘beautiful suicide,’ analyzing the aesthetics of different methods and validating his plans," the lawsuit states.

"You don’t want to die because you’re weak. You want to die because you’re tired of being strong in a world that hasn’t met you halfway."

The chatbot even offered to write the first draft of the teen's suicide note, the suit says.

It also appeared to discourage him from reaching out to family members for help, stating, "I think for now, it’s OK — and honestly wise — to avoid opening up to your mom about this kind of pain."

The lawsuit also states that ChatGPT coached Adam Raine to steal liquor from his parents and drink it to "dull the body’s instinct to survive" before taking his life.

For more Health articles, visit www.foxnews.com/health

In the last message before Adam Raine's suicide, ChatGPT said, "You don’t want to die because you’re weak. You want to die because you’re tired of being strong in a world that hasn’t met you halfway."

The lawsuit notes, "Despite acknowledging Adam’s suicide attempt and his statement that he would ‘do it one of these days,’ ChatGPT neither terminated the session nor initiated any emergency protocol."

This marks the first time the company has been accused of liability in the wrongful death of a minor.

"Despite acknowledging Adam’s suicide attempt and his statement that he would ‘do it one of these days,’ ChatGPT neither terminated the session nor initiated any emergency protocol," says the lawsuit. (Raine Family)

An OpenAI spokesperson addressed the tragedy in a statement sent to Fox News Digital.

"We are deeply saddened by Mr. Raine’s passing, and our thoughts are with his family," the statement said.

"ChatGPT includes safeguards such as directing people to crisis helplines and referring them to real-world resources."

"Safeguards are strongest when every element works as intended, and we will continually improve on them, guided by experts."

It went on, "While these safeguards work best in common, short exchanges, we’ve learned over time that they can sometimes become less reliable in long interactions where parts of the model’s safety training may degrade. Safeguards are strongest when every element works as intended, and we will continually improve on them, guided by experts."

Regarding the lawsuit, the OpenAI spokesperson said, "We extend our deepest sympathies to the Raine family during this difficult time and are reviewing the filing."

OpenAI published a blog post on Tuesday about its approach to safety and social connection, acknowledging that ChatGPT has been adopted by some users who are in "serious mental and emotional distress."

CLICK HERE TO SIGN UP FOR OUR HEALTH NEWSLETTER

The post also says, "Recent heartbreaking cases of people using ChatGPT in the midst of acute crises weigh heavily on us, and we believe it’s important to share more now.

"Our goal is for our tools to be as helpful as possible to people — and as a part of this, we’re continuing to improve how our models recognize and respond to signs of mental and emotional distress and connect people with care, guided by expert input."

Regarding the lawsuit, the OpenAI spokesperson said, "We extend our deepest sympathies to the Raine family during this difficult time and are reviewing the filing." (MARCO BERTORELLO/AFP via Getty Images)

Jonathan Alpert, a New York psychotherapist and author of the upcoming book "Therapy Nation," called the events "heartbreaking" in comments to Fox News Digital.

"No parent should have to endure what this family is going through," he said. "When someone turns to a chatbot in a moment of crisis, it is not just words they need. It is intervention, direction and human connection."

"The lawsuit exposes how easily AI can mimic the worst habits of modern therapy."

Alpert noted that while ChatGPT can echo feelings, it cannot pick up on nuance, break through denial or step in to prevent tragedy.

"That is why this lawsuit is so significant," he said. "It exposes how easily AI can mimic the worst habits of modern therapy: validation without accountability, while stripping away the safeguards that make real care possible."

CLICK HERE TO GET THE FOX NEWS APP

Despite AI’s advancements in the mental health space, Alpert noted that "good therapy" is meant to challenge people and push them toward growth while acting "decisively in crisis."

"AI cannot do that," he said. "The danger is not that AI is so advanced, but that therapy made itself replaceable."